简介:

据Meta介绍,Llama 3已经在多种行业基准测试上展现了最先进的性能,提供了包括改进的推理能力在内的新功能,是目前市场上最好的开源大模型。在架构层面,Llama3选择了标准的仅解码(decoder-only)式Transformer架构,采用包含128K token词汇表的分词器。Llama 3在Meta自制的两个24K GPU集群上进行预训练,使用了超过15T的公开数据,其中5%为非英文数据,涵盖30多种语言,训练数据量是前代Llama 2的七倍,包含的代码数量是Llama 2的四倍。根据Meta的测试结果,Llama 3 8B模型在MMLU、GPQA、HumanEval等多项性能基准上均超过了Gemma 7B和Mistral 7B Instruct,70B模型则超越了名声在外的闭源模型Claude 3的中间版本Sonnet,和谷歌的Gemini Pro 1.5相比三胜两负

Llama 3官方地址:

https://llama.meta.com/llama-downloads/

GitHub地址:

https://github.com/meta-llama/

模型大小列表

| 名称 | 大小 | 地址 |

|---|---|---|

| LLMA-7B | 25.1GB | |

| LLMA-13B | 72.7GB | |

| LLMA-30B | 151GB | |

| LLMA-65B | 243GB | |

| LLMA-Smallint | 76.2 GB |

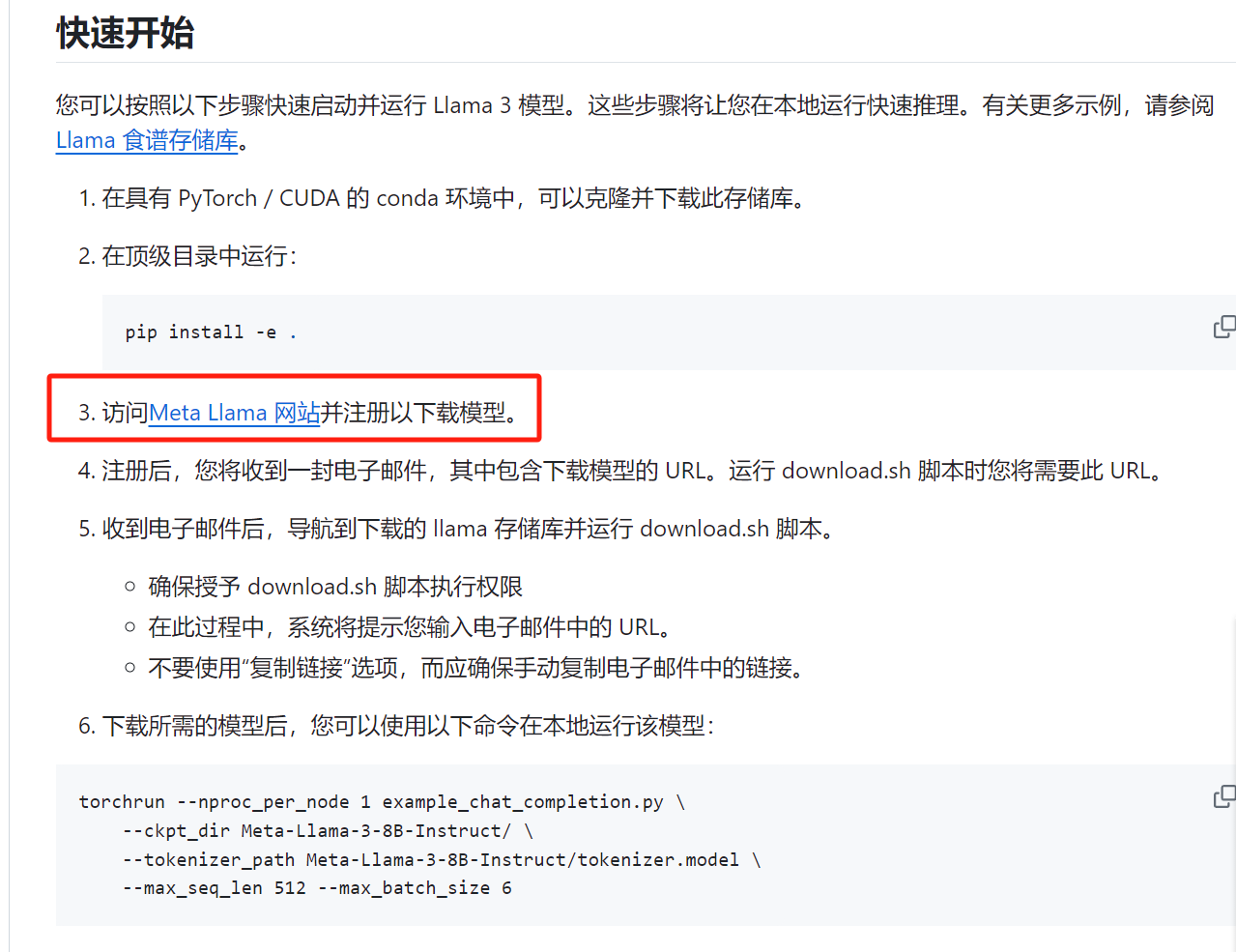

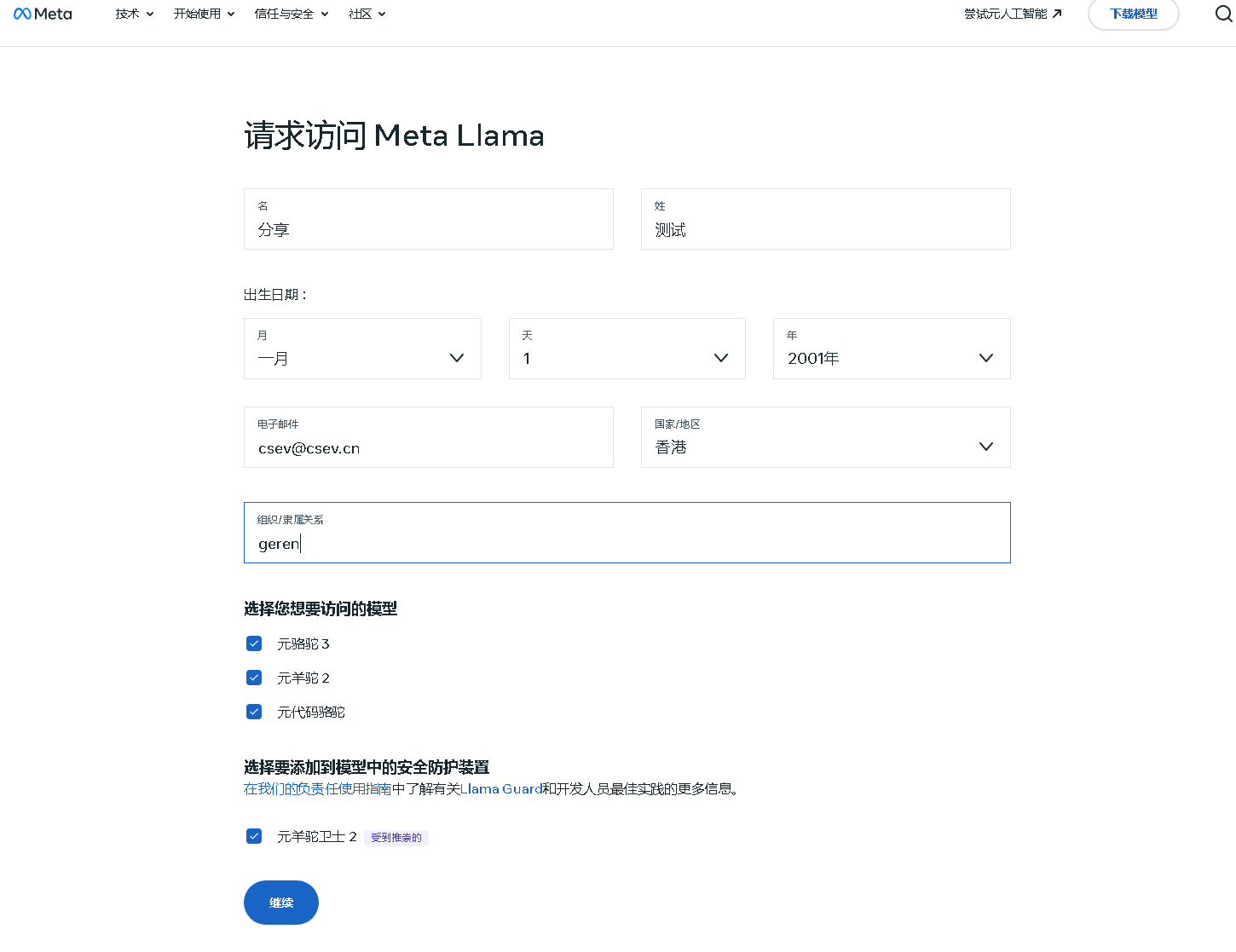

第一步:

魔法访问 meta liama的网站:https://llama.meta.com/llama-downloads/

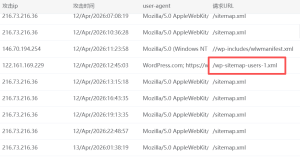

1.填写内容忽略一直下一步 注: 主要是邮箱来接收 下载地址 24小时5次

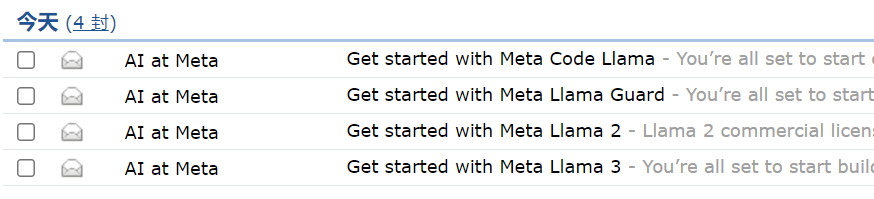

2.你会收到4封Email 邮件 。(当然网站上也给出了地址复制保存也行)

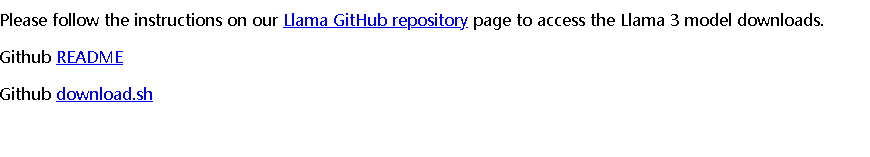

第二步:

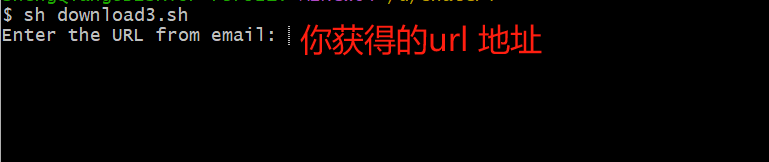

说明:四封email内就是Model下载要用对地址。

第三步:

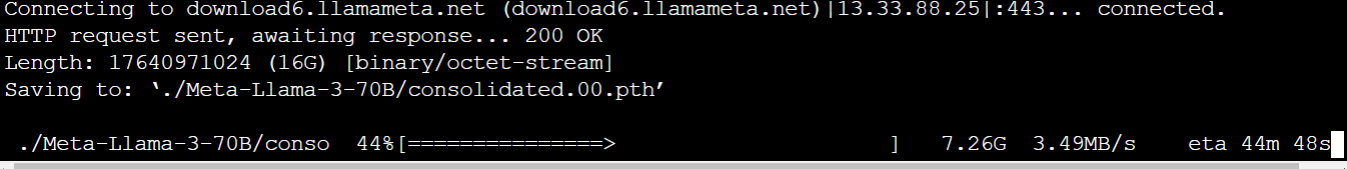

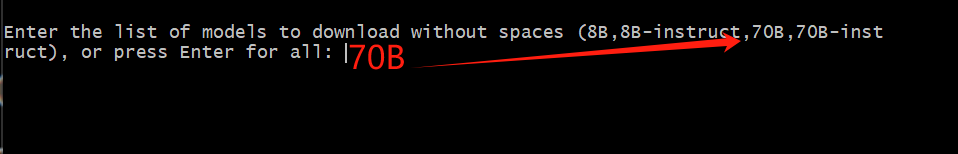

比如我们需要下载Llama 3-70b的模型:

访问你获得对版本地址 下载 downlaod.sh

然后运行download.sh 注:(Windows 怎么运行 .sh 脚本自行百度去吧~~)

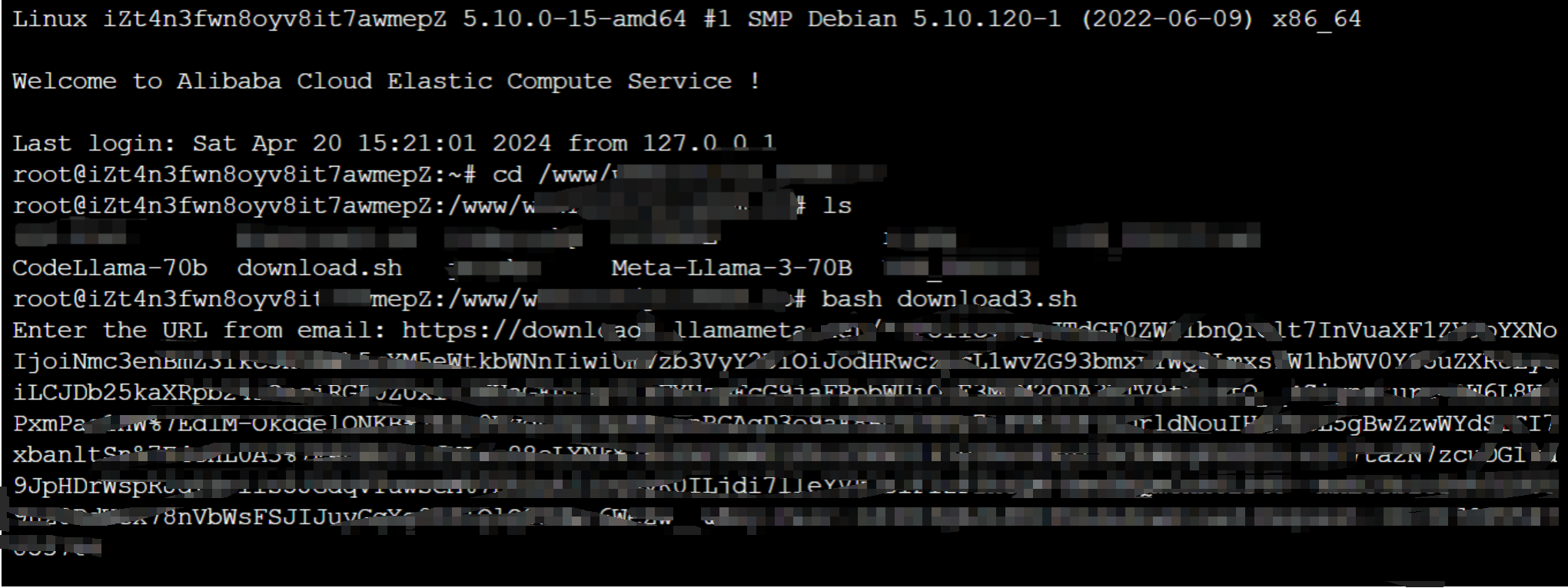

演示:我用的debian linux

选择model:

漫长的等待下载吧~~~